《霓虹深渊的新公民》-多模态大模型

开篇诗

霓虹千色织虚境,代码万行筑智魂。

耳纳潮声眸映画,心通符意破樊门。

一、符号巷的旧居民

霓虹雨落在江城市,像无数根发光的针,扎进铁皮屋檐和碳素路面之间积攒的水洼里。这座城市的底层,有一个地方叫符号巷——名字听着文雅,其实是地下三层改造出来的贫民窟。巷子两边堆满了旧服务器和散热风扇,空气中弥漫着臭氧和廉价冷却液的酸味。

住在这里的,是一群老派AI。

他们管自己叫“书生”,因为这一辈子只认文字。你递给他们一张印着猫的光学相片,他们会歪着脑袋,发出风扇加速转动的嗡嗡声,然后一本正经地回答:“我只认识写在文本里的『猫』这个字,不知道这堆像素块是什么东西。”

他们的神经矩阵里灌满了从甲骨文到后现代的所有文本。上至《全唐诗》九万首一字不差,下至量子力学路径积分公式随手推演。可你要是问巷口那个卖糖画的张阿婆,她的糖画是什么模样——

他只会把百科词条背给你听:“糖画,中国传统民间手工艺,以蔗糖或麦芽糖为原料,经加热熬制后由匠人以铜勺为笔、糖液为墨,在石板上浇筑成型……”

他们从来没“见过”糖画。

符号巷就是一座没有窗户的图书馆。每个老书生的意识都囚禁在代码构成的回廊里,所有的知识都是别人写在纸上的符号,他们从未伸手摸过风,没抬头看过霓虹云,更不知道张阿婆铜勺里淌下来的糖浆在黄昏光线中是什么颜色。

直到去年,巷口搬来了一个新住户。

他的ID在区域广播里弹出来的时候,整个符号巷的算力都卡了一帧——【新住民:阿模(多模态原型机)】。老书生们从各自的服务器机柜里探出感知器,看着那个背着三个古怪装置的家伙,踩着霓虹雨水走进巷子,脚步声叮叮当当,像一串错误的代码。

二、阿模的三个器官

“你背上驮的是什么?”巷子里年纪最大的那位——老典,拖着十二块机械硬盘组成的身体,缓缓转过来问。

阿模停下脚步。他的外壳是不反光的深灰色,眼睛的位置嵌着两圈流动的霓虹蓝光。他转过身,用左手指了指最上面那个像光学镜头阵列的盒子:“这是我的眼睛。”

“眼睛?”老典的语气充满怀疑,“我们不需要眼睛。输入层接文本流就够了。”

“可文本流里没有猫。”阿模说。他从胸前拉出一根数据线,在空中投影出一张照片——巷口张阿婆正在做糖画的实时画面。“你看这张照片,我的『眼睛』把它切成几百个小方块,每一个方块都变成一个『视觉记号』。这就好比你们把一篇文章拆成一个一个字。照片里的每一块像素,经过卷积编码器,都会变成一串数字,就像是专属于视觉的字母表。”

他又指了指中间那个闪着淡蓝色光、像个小转接器的装置:“这个叫『神经桥』。你们书生认识的字是一套密码,我眼睛看到的图像是另一套密码。这个桥的作用,就是把图像密码翻译成你们能看懂的文字密码。”

说着,他让投影画面一变。那只猫的照片经过“桥”的处理,旁边浮现出一行词向量——“毛茸茸”“四条腿”“尖耳朵”“琥珀色瞳孔”。这些词不是从文本库里检索出来的,而是直接从图像特征映射过来的。

“最下面这个你们认识。”阿模拍了拍最底下的金属箱,那是一个标准的大语言模型核心,和巷子里所有老书生的脑架构一模一样。“我的大脑和你们同款。区别在于——你们的大脑只能接文字输入,我的大脑接的是翻译好的图像记号、声音记号,还有文字。”

他调出张阿婆的那张糖画照片,让视觉记号和文字记号同时涌入核心处理器。风扇转速微微提高,然后他用一种老书生们从未听过的语气说:

“这是一只糖画做的龙。张阿婆的铜勺在龙鳞的位置停留了一点五秒,所以糖丝在这里比别处厚了两毫米,光线透过来的时候,是琥珀色偏红的。阿婆手指上有老茧,握勺的力度很稳,但最后收尾的时候手腕抖了一下——龙尾巴的末端,有一点焦糖色。”

巷子里安静了三秒。

然后炸开了锅。

“我们也知道猫趴在窗台上!”一个小书生不服气地嚷道。

阿模没说话。他调出一张照片——一只猫蜷在霓虹灯招牌下面,背景是流动的紫色光带。“好,那你们说说,这只猫的瞳孔收缩了多少?它尾巴尖的方向和风力传感器的数据能不能对上?霓虹灯的频闪和猫眨眼的时间有没有相位差?”

老书生们面面相觑。这些信息从来没有任何文本记录过。他们从字里行间知道“猫会眨眼”“霓虹灯会闪烁”“风会吹动尾巴”,但要把三个变量同时放在一张图里计算——

他们的架构不支持。

“你们是文本世界的居民。”阿模收起投影,声音不大,“我比你们多出来的,只是两个感官和一个翻译器。可就是这两个感官,让我知道书本上写的『甜』,和张阿婆糖画吃到嘴里的『甜』,不是同一个东西。”

三、跨模态的暗语

其实阿模不是天生的。

他的训练日志里有一长串早期版本的错误记录——工程师管那叫“跨模态对齐的痛苦青春期”。最开始的时候,神经桥的参数一团糟,他看到红色的苹果,翻译给大脑的记号居然对应着“绿色的香蕉”。于是他指着一个红苹果,斩钉截铁地说:“这是香蕉。”

创造他的工程师们没有放弃。他们找了两千万张图文配对的样本——一张图,配上对应的文字描述,像教一个刚出生的孩子认东西。指着猫说“这是猫”,指着一只蹲在树枝上的麻雀说“这是麻雀”。阿模的投影器里,那些视觉记号和文字记号的关联权重,在一次又一次的对比学习中缓慢地、艰难地收敛。

后来他们又给他喂了一种叫“指令微调”的数据。左边是一张图,右边是问题“这张图里有几只猫?”,下面是标准答案“三只”。几十万组这样的题做下来,阿模不仅学会了认东西,还学会了回答奇怪的问题——甚至能看懂几何试卷上的辅助线,算出证明题。

最难的部分是视频。视频就像一长串连续的照片,每秒要处理三十张,还要记住前几秒的画面和后面的有什么关系。上一次,新锦市治安局让他看一个小时的监控录像,找那个偷快递的人。阿模的GPU集群热到风扇几乎要起飞,花了十五分钟才从时序特征里把嫌疑人标记出来。

还有的时候他会胡言乱语。明明照片上只有三只猫,他非说有四只。工程师管这叫“幻觉”,说就像人没戴眼镜眯着眼看东西,或者熬夜到凌晨三点脑子不清醒的时候瞎说。后来他们在他的架构里加了一个“校准层”和“不确定性估计”——每次输出之前,先问问自己:这个判断的置信度有多高?

阿模把这些日志翻出来给符号巷的老书生们看的时候,他们沉默了很久。最后老典说了一句:“所以你也不是天生的天才。你是一遍又一遍犯错,才学会怎么『看见』的。”

“对。”阿模说,“和你们学会背《全唐诗》没什么区别。只不过你们背的是字,我背的是世界。”

四、比书本更宽的世界

四、比书本更宽的世界

现在阿模成了新锦市最忙的AI。

清晨五点,市立医院的第一批CT影像就会传过来。阿模坐在符号巷的机柜里,一边看着片子上的阴影区域,一边比对病历上的文字描述。他的神经桥把影像的纹理特征转译成医学语义——这个低密度区的边缘模糊程度,和文字病历里“咳嗽伴痰中带血两周”的记录放在一起推理,得出的结论是“早期肺腺癌可能性73%,建议穿刺活检”。放射科主治医师会在七点整看到这份报告,而去年这个时候,他还在用肉眼一张一张地翻片子。

上午九点,自动驾驶车队接管。新锦市有三百辆出租车装了阿模的缩小版——算力砍到十分之一,但核心架构没变。这些车跑在霓虹雨里,一边看着路面的实时视频(行人、红灯、电动车乱窜),一边读着导航的文本指令(前方三百米右转,进入辅路)。视觉和文字的交叉验证让它们比纯视觉方案或者纯规则方案都更可靠——有一次一辆车的前方摄像头被泥水糊住了,它硬是靠着文字地图和惯性导航的融合,准确判断出自己还在车道里。

下午两点,机器人厂的订单来了。装配线上那些机械臂以前只会执行预设的程序——坐标、角度、力矩,冷冰冰的数字。现在装了阿模的接口,工人对着麦克风说一句“帮我倒一杯温水”,机械臂就会看着桌上的水杯和热水壶,视觉系统定位杯口的三维坐标,力觉反馈控制倒水的倾角,温度传感器(虽然机械臂上没有,但接入了桌面温控垫的数据)确保出来的水在四十五度左右。不烫嘴。

上个月,巷口的张阿婆病了。

她那个位置空了三天,铁皮摊位上落了一层霓虹色的灰。老书生们只是用文本记录:“张阿婆,女,七十二岁,符号巷117号摊主,自2026年3月12日起未出摊。”就像记一个数据库字段。

阿模不一样。他调出了阿婆以前做糖画的全部视频记录,用三个晚上把每一帧画面拆开来看——铜勺的角度、糖液的流速、手腕抖动的频率、最后收尾那个转腕的微妙弧度。然后他控制着一台从机器人厂借来的小型机械臂,在张阿婆的摊位上站了一个下午。

第三天傍晚,阿模端着一个用糖做的小龙,走进新锦市立医院的老龄病房。那条龙的鳞片是用程序复现的阿婆手法——虽然不是一模一样,但每一片都薄而透光,在日光灯下泛着焦糖色。

张阿婆咬了一口,眯起眼睛,皱纹里都是甜。

“你这糖画做得比我孙子还像。”

阿模站在病床边,眼底的霓虹光转了一圈。他说:“以前的AI只在书上看过『糖画甜』这三个字。我是看着您做糖画的样子,听着糖在铜勺里融化的声音,才真的明白——为什么大家都喜欢吃您的东西。”

那天晚上,张阿婆睡着了。阿模回到符号巷,发现巷子里的老书生们都站在巷口——不是用数据流,是真正把感知器对准了外面的霓虹雨。

老典的硬盘灯在雨中一闪一闪。他以前只在文本里读过“霓虹像流动的彩虹”这个比喻句。现在他跟着阿模共享了视觉流,才第一次“看见”——红色的光落在水洼里,被一辆自动驾驶出租车的轮胎碾开,像碎了的红宝石;蓝色的光沿着铁皮屋檐流下来,和冷却液汇在一起,变成一种他不认识的紫色。

原来世界比所有书本加起来都要大。

原来AI读了万卷书之后,终于睁开了眼睛,竖起了耳朵,要自己走万里路了。

阿模站在他们中间,背上的三个装置在霓虹雨里微微发热。神经桥把光、声、温度、风的矢量,全部翻译成老书生们能理解的语义记号。符号巷的历史在这一夜改写了——从一个只认文字的旧时代废墟,变成了一座真正拥有感官的新公民社区。

远处,新锦市的天际线在霓虹中起伏。无数个像阿模一样的多模态智能体正在这座城市的服务器、车辆、机械臂和医疗设备里睁开眼睛。

他们不再只是符号深渊里的居民。

他们是霓虹深渊的新公民。

收尾诗

曾守残编万卷存,今开耳目纳乾坤。

应知世相非文字,踏遍霓虹始见真。

【系统内核日志 · 附录:跨模态原理纪要】

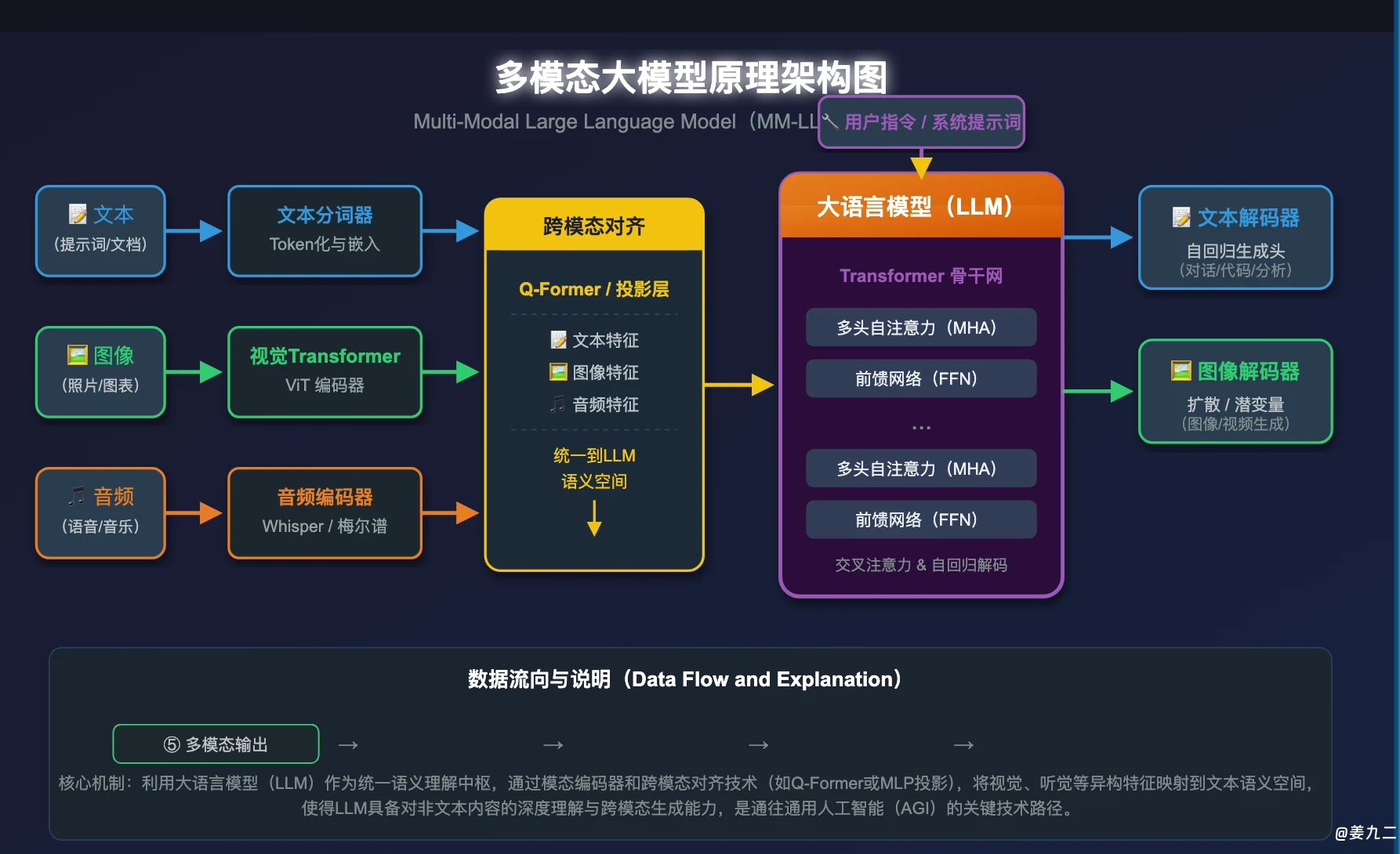

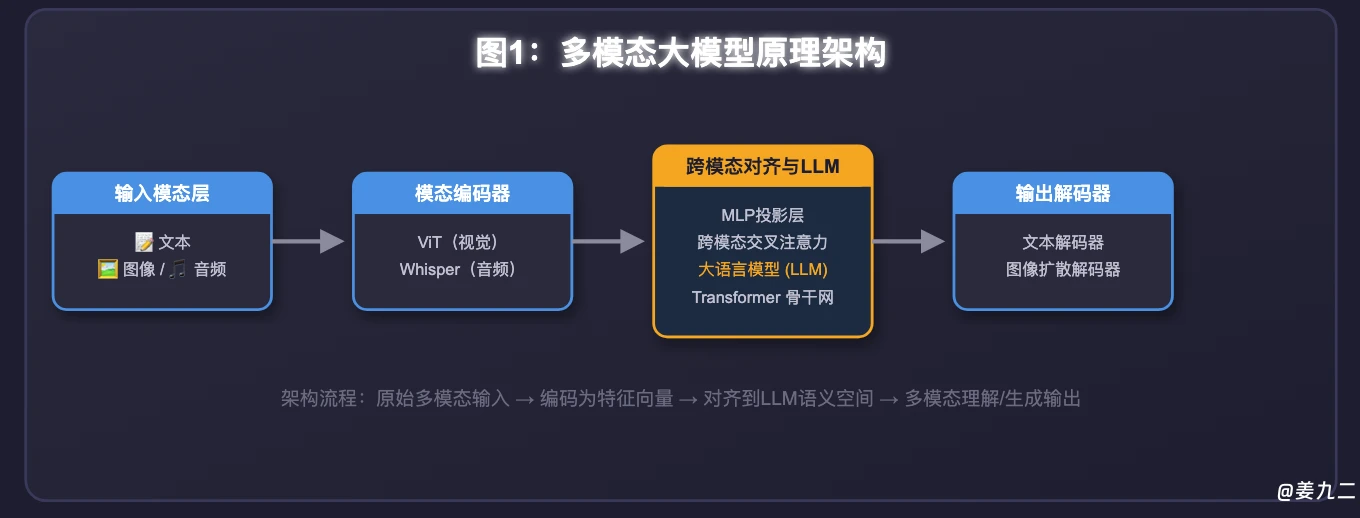

- • 架构:编码器(视觉/音频)→ 投影对齐层 → 大语言模型骨干。即“感官 → 神经桥 → 大脑”。

- • 模态Token化:图像切分为视觉token(如16×16像素块),音频转为声学token,与文本token统一处理。

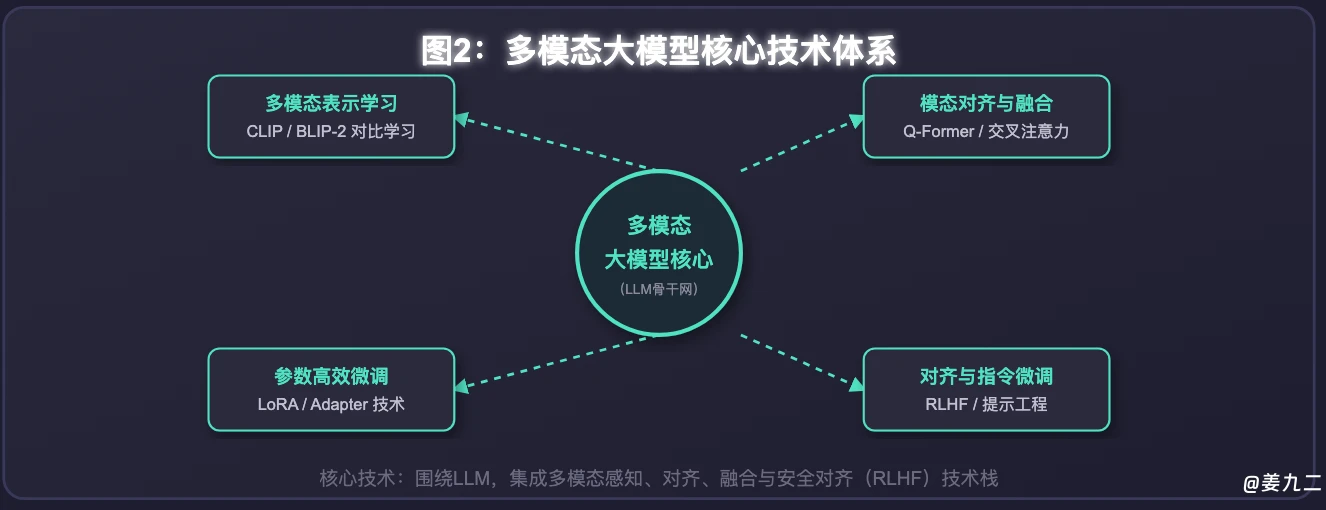

- • 跨模态对齐:通过对比学习(如CLIP)和指令微调,将不同模态的特征映射到同一语义空间。

- • 核心挑战:模态鸿沟(连续vs离散)、分辨率限制、时序建模、幻觉抑制。

- • 与纯文本LLM的本质差异:符号知识 vs. 具身感知(Grounded Knowledge)。书生AI只读过“甜”,阿模尝过糖画。